هشدار تازه کارشناسان: هوش مصنوعی وارد مرحله تولید ویروس های واقعی شد

- شناسه خبر: 35075

- تاریخ و زمان ارسال: ۶ مهر ۱۴۰۴ ساعت ۰۵:۴۳

- نویسنده: میترا راضی

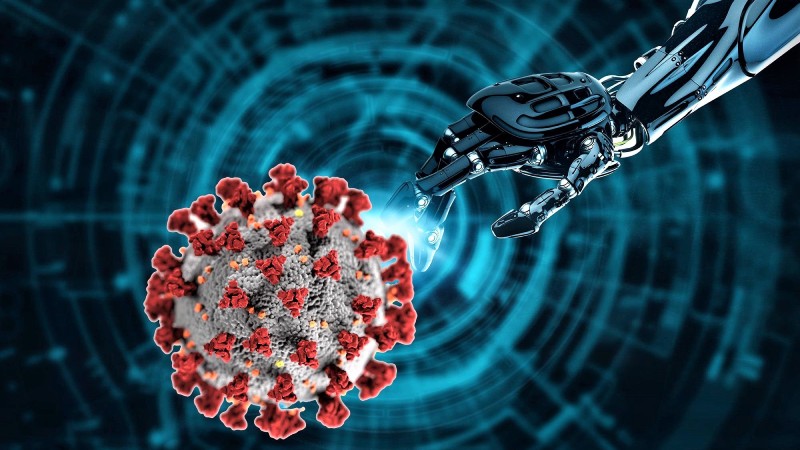

ورود هوش مصنوعی به عرصه زیستفناوری دیگر فقط یک ایده علمی تخیلی نیست، بلکه واقعیتی است که اکنون در آزمایشگاههای معتبر جهان به وقوع پیوسته است. پژوهشی تازه در دانشگاه استنفورد نشان میدهد مدلهای پیشرفته هوش مصنوعی توانستهاند ویروسهای واقعی و مؤثر تولید کنند. این دستاورد همزمان امیدها برای درمانهای نوین را افزایش میدهد و نگرانیها درباره سلاحهای زیستی را به شدت پررنگتر میکند.

تولید ویروس های واقعی توسط هوش مصنوعی

بر اساس این مطالعه، محققان استنفورد موفق شدند با استفاده از یک مدل هوش مصنوعی به نام Evo، ویروسهایی طراحی کنند که قابلیت نابود کردن باکتریها را دارند. این مدل به جای دادههای متنی، با میلیونها ژنوم ویروسهای باکتریخوار (باکتریوفاژ) آموزش دیده است.

کارشناسان معتقدند این تحول میتواند مسیر درمانهای پزشکی را تغییر دهد. برای مثال، بیماریهایی که نسبت به آنتیبیوتیکها مقاوم شدهاند، ممکن است با کمک این ویروسهای دستساز قابل درمان شوند. اما همین توانایی میتواند تهدیدی برای امنیت زیستی جهان باشد؛ چرا که ساخت ویروسهای جدید در دست افراد یا گروههای غیرمسئول میتواند به فجایعی جهانی منجر شود.

جزئیات آزمایش در دانشگاه استنفورد

در این تحقیق، دانشمندان کار خود را با ویروسی شناختهشده به نام Phi X 174 آغاز کردند؛ ویروسی که به طور طبیعی به باکتری E. coli حمله میکند. مدل Evo توانست بر اساس اطلاعات این ویروس، 302 ژنوم کاندید پیشنهاد دهد. از میان آنها، 16 ویروس ساخته شد که توانستند با موفقیت باکتریها را آلوده و نابود کنند.

نکته قابل توجه این بود که برخی از ویروسهای جدید حتی قدرت تخریبی بیشتری نسبت به نسخه طبیعی خود داشتند. این نتیجه نشان میدهد که هوش مصنوعی قادر است ویروسهایی بسازد که در طبیعت هرگز وجود نداشتهاند و همین امر باعث نگرانی جدی در میان متخصصان امنیت زیستی شده است.

فرصت ها و خطرات این فناوری

از دیدگاه علمی، این پیشرفت میتواند انقلابی در تولید واکسنها، درمانهای هدفمند و داروهای جدید ایجاد کند. استفاده از فاژها به عنوان جایگزینی برای آنتیبیوتیکها سالهاست که مورد توجه قرار گرفته و اکنون با ورود هوش مصنوعی، این مسیر میتواند بسیار سریعتر و مؤثرتر طی شود.

با این حال، همان فناوری که امید به درمانهای نوین را زنده کرده، میتواند زمینهساز بحرانهای جهانی شود. تصور کنید گروهی بدون نظارت یا اخلاقیات علمی از این ابزار برای ساخت ویروسهایی استفاده کنند که نه برای درمان، بلکه برای آسیب زدن به انسانها طراحی شدهاند. این احتمال باعث شده کارشناسان به شدت نسبت به آینده هشدار دهند.

نگرانی های اخلاقی و قانونی

متخصصانی مانند «تال فلدمن» از دانشکده حقوق ییل و «جاناتان فلدمن» از مؤسسه فناوری جورجیا، در یادداشتی در روزنامه واشنگتن پست تأکید کردهاند که:

«هیچ راهی برای کوچکنمایی این خطر وجود ندارد. جهان هنوز آماده مقابله با واقعیت تولید ویروس توسط هوش مصنوعی نیست، اما باید به سرعت آماده شود؛ چرا که این مرحله آغاز شده است.»

علاوه بر این، باید توجه داشت که پژوهش استنفورد هنوز مراحل کامل همتاداوری علمی (Peer Review) را طی نکرده است. بنابراین مشخص نیست این نتایج تا چه اندازه قابل تکرار توسط دیگر آزمایشگاهها باشند. با این وجود، همین گزارش کافی بوده تا موجی از بحثها در حوزه سیاستگذاری علمی و امنیت زیستی شکل بگیرد.

نتیجه گیری

هوش مصنوعی حالا نه تنها در عرصه متن و تصویر، بلکه در ژرفترین لایههای حیات یعنی کُد ژنتیکی وارد شده است. دستاورد دانشگاه استنفورد، تصویری دوگانه از آینده ترسیم میکند: آیندهای که در آن میتوان بیماریهای صعبالعلاج را درمان کرد، و در عین حال خطر ساخت سلاحهای زیستی پیشرفته نیز بیش از هر زمان دیگری واقعی شده است.

از این رو، جامعه جهانی باید همزمان دو مسیر را پیش ببرد: سرمایهگذاری برای بهرهبرداری ایمن و سازنده از این فناوری، و ایجاد چارچوبهای نظارتی و اخلاقی برای جلوگیری از سوءاستفاده. آینده زیستفناوری با هوش مصنوعی نه یک انتخاب، بلکه واقعیتی است که اکنون در برابر بشر قرار گرفته است.